实时计算 Flink版产品使用问题之如何对starrocks进行分桶

2024-07-16 110 发布于安徽

版权

举报

版权声明:

本文内容由阿里云实名注册用户自发贡献,版权归原作者所有,阿里云开发者社区不拥有其著作权,亦不承担相应法律责任。具体规则请查看《 阿里云开发者社区用户服务协议》和 《阿里云开发者社区知识产权保护指引》。如果您发现本社区中有涉嫌抄袭的内容,填写 侵权投诉表单进行举报,一经查实,本社区将立刻删除涉嫌侵权内容。

简介: 实时计算Flink版作为一种强大的流处理和批处理统一的计算框架,广泛应用于各种需要实时数据处理和分析的场景。实时计算Flink版通常结合SQL接口、DataStream API、以及与上下游数据源和存储系统的丰富连接器,提供了一套全面的解决方案,以应对各种实时计算需求。其低延迟、高吞吐、容错性强的特点,使其成为众多企业和组织实时数据处理首选的技术平台。以下是实时计算Flink版的一些典型使用合集。

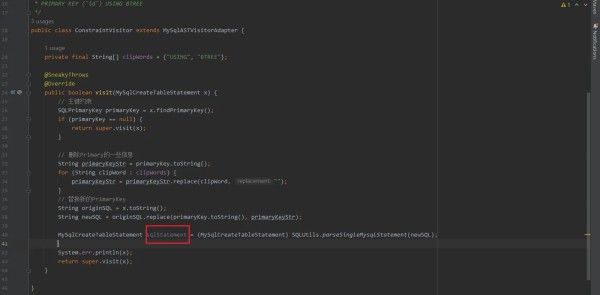

问题一:Flink CDC里如何把这个新的sqlStatment返回出去?

Flink CDC里如何把这个新的sqlStatment返回出去?

参考答案:

在Flink CDC中,你可以通过以下步骤将新的SQL语句返回出去:

首先,你需要创建一个StatementSetter接口的实现类。这个接口有一个方法setSqlStatement,你可以在这里设置你的SQL语句。public class MyStatementSetter implements StatementSetter { private String sql; @Override public void setSqlStatement(String sql) { this.sql = sql; } public String getSql() { return sql; } }然后,你需要在你的Flink CDC程序中创建一个DebeziumSourceFunction实例,并传入你的StatementSetter实现类的实例。

DebeziumSourceFunction<String> sourceFunction = new DebeziumSourceFunction<>( configuration, new MyStatementSetter(), tableIdentification, deserializer, databaseHistory, handleEventsMethod, handleQueryRequestMethod);最后,你可以在你的handleEventsMethod或者handleQueryRequestMethod方法中获取到你的SQL语句。

@Override public void handleEvents(Collection<Row> rows, long timestamp) { for (Row row : rows) { String sql = myStatementSetter.getSql(); // do something with the sql statement } } @Override public void handleQueryRequest(long timestamp, String sql) { String sqlStatement = myStatementSetter.getSql(); // do something with the sql statement }

这样,你就可以在你的Flink CDC程序中获取到新的SQL语句了。

关于本问题的更多回答可点击进行查看:

https://developer.aliyun.com/ask/590879

问题二:Flink CDC里我通过oracle的connector往hudi插入数据,为什么不变 ?

Flink CDC里我通过oracle的connector往hudi插入数据,flink web ui里面为啥Sink: clean_commits 这个步骤并行度是1,我设置的默认并行度是5,但是它改变不了为什么?

参考答案:

Flink CDC中,Sink: clean_commits步骤的并行度是由Hudi 0.9.0版本引入的。在Hudi 0.9.0之前的版本中,clean_commits步骤是串行执行的,因此并行度为1。而在Hudi 0.9.0及以后的版本中,clean_commits步骤可以并行执行,并行度由参数hoodie.datasource.write.hive_sync.parallelism控制。

如果你使用的是Hudi 0.9.0或更高版本,并且已经设置了默认并行度为5,但Sink: clean_commits步骤的并行度仍然为1,可能有以下几种原因:

检查你的Flink作业配置是否正确。确保你已经正确设置了hoodie.datasource.write.hive_sync.parallelism参数的值。你可以在Flink Web UI中找到该参数的配置项,并确认其值是否与你预期的一致。检查你的Hudi配置是否正确。确保你已经正确配置了Hudi的相关参数,例如hoodie.datasource.write.recordkey.field、hoodie.datasource.write.partitionpath.field等。这些参数的配置可能会影响Sink: clean_commits步骤的并行度。

检查你的数据源和目标存储系统是否正常工作。如果数据源或目标存储系统存在问题,可能会导致Sink: clean_commits步骤无法正常执行,从而影响并行度的设置。

如果以上方法都无法解决问题,你可以尝试在Flink社区或相关论坛上提问,以获取更详细的帮助和支持。

关于本问题的更多回答可点击进行查看:

https://developer.aliyun.com/ask/590877

问题三:Flink CDC里模式应该如何配置使用呢?

https://ververica.github.io/flink-cdc-connectors/master/content/%E5%BF%AB%E9%80%9F%E4%B8%8A%E6%89%8B/mysql-starrocks-pipeline-tutorial-zh.html

Flink CDC里有个问题想请教下,以上文档介绍的是flink on standalone 模式的使用示例。 请问其他一些常用的flink on yarn perjob 和 application 模式支持吗,应该如何配置使用呢?

参考答案:

Flink CDC支持在YARN上运行,包括per-job模式和application模式。以下是一些配置和使用说明:

首先,确保你的Flink集群已经安装并配置好了YARN。你可以在Flink的官方文档中找到关于如何在YARN上部署Flink集群的详细说明。在你的Flink项目中,添加以下依赖到你的pom.xml文件中(如果使用Maven构建项目):

<dependency> <groupId>org.apache.flink</groupId> <artifactId>flink-connector-mysql-cdc</artifactId> <version>2.1.0</version> </dependency>在你的Flink应用程序中,创建一个StreamExecutionEnvironment实例,并设置相关参数,例如并行度、检查点等。然后,使用addSource方法添加一个MySQL CDC源,并连接到你的MySQL数据库。最后,将数据流转换为你需要的数据格式,并将其输出到目标存储系统。

为了在YARN上运行你的Flink应用程序,你需要将你的项目打包成一个JAR文件,并在提交作业时指定相关的YARN资源管理器参数。例如,你可以使用以下命令提交你的作业:

yarn jar your-flink-job.jar -yn <numTaskManagers> -ys <slotsPerTaskManager> -yjm <jobManagerMemory> -ytm <taskManagerMemory> -quz <queueName> -cls <classpath> -Dyarn.application.name=<applicationName>

其中,<numTaskManagers>、<slotsPerTaskManager>、<jobManagerMemory>、<taskManagerMemory>、<queueName>、<classpath>和<applicationName>需要替换为你的实际参数值。

在提交作业后,你可以通过YARN ResourceManager的Web界面查看作业的状态和日志信息。关于本问题的更多回答可点击进行查看:

https://developer.aliyun.com/ask/590873

问题四:Flink CDC里对starrocks 进行分桶FlinkSQL能做吗?或们预先创建出分桶表了?

Flink CDC里对starrocks 进行分桶FlinkSQL能做吗,还是你们预先创建出分桶表的了?

参考答案:

Flink CDC可以与StarRocks进行集成,并且可以在Flink SQL中对StarRocks表进行分桶操作。

在Flink SQL中,你可以使用CREATE TABLE语句创建一个外部表,并指定其存储在StarRocks中。然后,可以使用CLUSTER BY子句对表进行分桶操作。例如:

CREATE TABLE my_table ( id INT, name STRING, age INT ) WITH ( 'connector' = 'starrocks', 'hostname' = '<your-starrocks-host>', 'port' = '<your-starrocks-port>', 'database' = '<your-starrocks-database>', 'username' = '<your-starrocks-username>', 'password' = '<your-starrocks-password>', 'table-name' = '<your-starrocks-table>' ) CLUSTERED BY (id) INTO 10 BUCKETS;

在上面的示例中,我们创建了一个名为my_table的外部表,并将其存储在StarRocks中。通过使用CLUSTERED BY子句,我们将表按照id列进行分桶操作,并将数据分为10个桶。

请注意,你需要根据实际情况替换示例中的占位符(如主机名、端口号、数据库名称等)。此外,还需要确保你已经正确配置了Flink CDC和StarRocks之间的连接信息。

关于本问题的更多回答可点击进行查看:

https://developer.aliyun.com/ask/590872

问题五:Flink CDC里stream park有计划接入flink-cdc 3.0来管理任务吗?

Flink CDC里stream park有计划接入flink-cdc 3.0来管理任务吗?

参考答案:

是的,Flink CDC 3.0计划将stream park功能纳入其管理任务的范围。这将使得用户能够更方便地管理和监控他们的数据流任务。

关于本问题的更多回答可点击进行查看:

https://developer.aliyun.com/ask/590871

相关实践学习

基于Hologres轻松玩转一站式实时仓库

本场景介绍如何利用阿里云MaxCompute、实时计算Flink和交互式分析服务Hologres开发离线、实时数据融合分析的数据大屏应用。

Linux入门到精通

本套课程是从入门开始的Linux学习课程,适合初学者阅读。由浅入深案例丰富,通俗易懂。主要涉及基础的系统操作以及工作中常用的各种服务软件的应用、部署和优化。即使是零基础的学员,只要能够坚持把所有章节都学完,也一定会受益匪浅。

网址:实时计算 Flink版产品使用问题之如何对starrocks进行分桶 https://m.mxgxt.com/news/view/1218851

相关内容

如何使用Flink,通过CTAS语句同步MySQL数据至StarRocks这是flink + smt + starrocks 的链接,请问sr 指的是什么组件?

StarRocks 1.19 新版本特性介绍

StarRocks x Paimon 构建极速实时湖仓分析架构实践

flink读取starRocks数据,只能读取历史的,不能读实时数据,怎么破?

跨越速运张杰:基于 StarRocks 提升运单分析时效|爱分析活动

各位大佬, StarRocks 如果写入数据速度过快, 容易将 StarRocks 写挂。 有对这个

[StarRocks 2024 年度技术峰会]:6 唯品会

StarRocks 跨集群数据迁移:SDM 帮你一键搞定!

滴滴 x StarRocks:极速多维分析创造更大的业务价值